Seit 2023 scheint die KI alle Diskussionen und Gespräche an sich zu reißen und wie eine Flutwelle alles wegzufegen.

Die Fragen werden immer zahlreicher, die Antworten bleiben jedoch spärlich. Die Entwicklung und Nutzung dieser Tools ist für die Unternehmen zu einer Priorität geworden, die sie zweifellos zu Recht als unumgänglichen Wendepunkt ansehen, erfordert jedoch die Einrichtung eines Governance-Rahmens, in dem die Antworten auf diese zahlreichen Fragen notwendig sind.

A. EU-Regelungen zur künstlichen Intelligenz

In den kommenden Wochen möchte ich einen Blick auf denjenigen werfen, der sich von einem „Vorschlag“ zu der nunmehr seit ihrer „Flucht“ am 22. Januar 2024 bekannten EU-Verordnung über KI entwickelt hat.

In Anlehnung an die Struktur und mit einer Veröffentlichung pro Woche werden wir nacheinander folgende Themen behandeln: (1) Allgemeine Bestimmungen; (2) KI-Systeme für allgemeine Zwecke; (3) Verbotene Praktiken; (4) Hochrisikopraktiken; (5) Transparenzpflichten; (6) Maßnahmen zur Innovationsförderung; (7) Governance; (8) Register; (9) Überwachungs- und Aufsichtspflichten; (10) Verhaltenskodizes; (11) Sanktionen; und schließlich (12) Fragen der Delegation von Befugnissen.

Bis die Prüfung der Verordnung nächste Woche beginnt, wollen wir diese Woche einen Überblick über den Stand der Dinge in Bezug auf die urheberrechtlichen Herausforderungen dieser Systeme anhand der aktuellen Rechtsfälle geben.

B. Der Fall NY Times gegen OpenAI und Microsoft

Die jüngste Klage, die die NY Times am 27. Dezember 2023 vor dem United States District Court Southern District of New York nicht nur gegen OpenAI, sondern auch gegen Microsoft eingereicht hat, ist vielleicht die symbolträchtigste, da zum ersten Mal ein großer Akteur ein Gericht anruft.

In einer 69-seitigen Klageschrift zeigt die NY Times anhand zahlreicher Beispiele auf, dass die von ChatGPT erzeugten Ergebnisse in vielen Fällen auf der Grundlage einfachster Prompts zu einer fast vollständigen Übernahme bestimmter veröffentlichter Artikel führen.

In diesem Fall geht es also nicht mehr nur um die Trainingsdaten (Input) – Fälle, in denen sich die Problematik des Fair Use in den USA mit unbestreitbarer Schärfe stellt -, sondern um das Ergebnis selbst (Output).

Wenn es um das Ergebnis (Output) geht, muss man zugeben, dass die Fair-Use Ausnahme zumindestin diesem Fall weit weniger überzeugend ist. Die NY Times zeigt anhand zahlreicher Beispiele, dass die Ergebnisse in vielen Fällen weitgehend auf ihren Artikeln basieren.

Für die NY Times besteht die Gefahr, dass Internetnutzer ihre Abonnements der Zeitung aufgeben, die, wie die NY Times betont, sehr wertvoll sind, um die journalistische Qualität in einer Zeit, in der Desinformation weit verbreitet ist, aufrechtzuerhalten. Der Fall betrifft nicht nur die NY Times, sondern auch die gesamte Pressewelt, deren Zukunft auf dem Spiel steht.

Auf den ersten Blick ist schwer zu erkennen, wie die Voraussetzungen für die Ausübung des Fair Use erfüllt sein könnten, und wie die Beklagten angesichts des Antrags, zumindest in diesem Stadium, einer Anerkennung ihrer Verletzung des Urheberrechts der NY Times entgehen könnten.

Am 8. Januar 2024 wies OpenAI in einem langen Brief die als irreführend empfundenen Behauptungen von OpenAI zurück. Wenig überraschend erinnerte sie daran, dass ungeachtet der Möglichkeit für Urheber, ein Opt-out zu machen, das Training geschützter Daten ein Fall von Fair Use ist. Sie fügte hinzu, dass die in der Klageschrift angeführten Beispiele in Wirklichkeit nur sehr seltene Fälle seien, die Prompts mit einer bewussten Absicht zur Manipulation des Systems widerspiegeln. Fall wird weiterverfolgt.

C. Laufende Fälle

Seit letztem Jahr gibt es zahlreiche Fälle, die sich mit urheberrechtlichen Fragen beschäftigen, und zwar sowohl mit Fragen rund um die Trainingsdaten (Input) als auch, in geringerem Maße, um das Ergebnis (Output).

(I) Urheberrechtsverletzung an Trainingsdaten (Input)?

In Bezug auf Fälle, die sich hauptsächlich mit Trainingsdaten befassen, sind in den USA ohne Anspruch auf Vollständigkeit zu nennen:

Außerhalb der USA sind außerdem zu erwähnen:

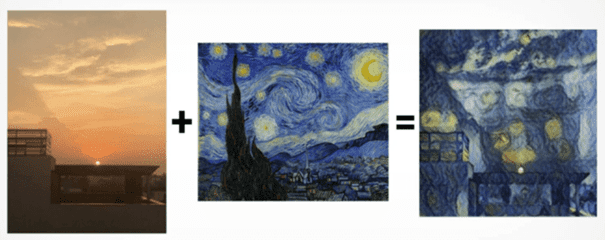

(II) Urheberrechte an den erzeugten Ergebnissen (Output)?

Dies war der Fall bei den Ämtern für geistiges Eigentum in Indien und Kanada, die das Werk Suryast der oben erwähnten Künstlerin Sahni eintragen ließen. Ähnlich war es in Südkorea, wo die Firma Nara Knowledge Information die Eintragung ihres Films „AI Suro’s Wife“ erhielt, für den sie die Tools Midjourney und Stable Diffusion verwendet hatte.

Das Beijing Internet Court gab am 27. November 2023 einer Klage wegen Urheberrechtsverletzung auf der Grundlage eines mit Stability Diffusion erzeugten Werks statt und erkannte an, dass die Abfolge der Prompts und das daraus resultierende Werk von einer sorgfältigen Auswahl und Anordnung sowohl der Prompts als auch der daraus resultierenden Ergebnisse zeugten:

D. Schlussfolgerung

Was lässt sich aus diesem Überblick über die Situation zu Beginn des Jahres 2024 schließen?

(I) Trainingsdaten

Es ist erstaunlich, dass OpenAI sich über die Vorwürfe aufregt, obwohl es offensichtlich Partnerschaften mit großen Akteuren anstrebt, die ihm einen massiven Datenstrom liefern können.

Im Juli 2023 unterzeichnete sie sowohl mit Associated Press als auch mit Shutterstock einen Lizenzvertrag, der es ihr erlaubte, deren Inhalte zu nutzen. Am 13. Dezember 2023 schloss sie einen Lizenzvertrag mit dem Verlagsriesen Axel Springer ab (wobei man sich fragen muss, ob sie sich damit nicht in den Fuß schießt, obwohl uns die Bedingungen des Geschäfts natürlich nicht bekannt sind).

In jedem Fall ist es schwer vorstellbar, warum OpenAI solche Vereinbarungen unterzeichnen sollte, wenn es nicht anerkennen würde, dass die Vervielfältigungen, die es vornimmt, indem es diese Daten reproduziert, um seine Vorlage zu trainieren, rechtswidrig sind.

Die aktuellen Fälle zeigen bereits, wie schwierig es für die Kläger sein kann, vor Gericht zu bestehen.

Die Debatte beschränkt sich nicht nur auf die Frage, ob diese Trainingsdaten die Rechte der Rechteinhaber verletzen und ob die Entwickler dieser generativen Werkzeuge eine Ausnahme geltend machen können. Zunächst einmal muss das angerufene Gericht überhaupt dafür zuständig sein. Während die meisten Fälle in den USA anhängig gemacht wurden, wo die Entwickler ihren Sitz haben und sich die Frage der Zuständigkeit nicht stellt, stellt sich die Frage anders, wenn die Rechteinhaber im Ausland klagen wollen. Der beim High Court of Justice in London anhängige Fall Getty Images unterstreicht die Tatsache, dass die Zuständigkeit dieses Gerichts eine offene Frage ist, über die der High Court zu entscheiden haben wird. Die bislang wenig untersuchten Aspekte des internationalen Privatrechts sollten nicht unterschätzt werden.

Zweitens müssen die Kläger, selbst wenn das Gericht zuständig ist, aktiv legitimiert sein, d. h. sie müssen nachweisen, dass Werke, an denen sie Rechte besitzen, konkret vervielfältigt wurden, um als Trainingsdaten zu dienen; eine bloße Behauptung, dass eine solche Verwertung angesichts der Anzahl der vervielfältigten Bilder mehr als wahrscheinlich erscheint, scheint nicht auszureichen. Die Messlatte könnte sich also als besonders hoch erweisen.

Wir können davon ausgehen, dass es in den kommenden Jahren Lösungen geben wird, z. B. in Form von Vergütungsansprüchen oder erweiterten kollektiven Lizenzen, aber nicht unbedingt in Form eines Blankoschecks für solche Trainings, wie es Japan, Singapur oder möglicherweise Israel getan haben.

(II) Generierte Ergebnisse

Zwar entschied sich die Ukraine 2023 für die Einführung eines Sui-generis-Rechts zum Schutz der von generativen Werkzeugen erzeugten Ergebnisse, doch scheint diese Entscheidung eine Ausnahme zu bleiben. Generell scheint die Frage entscheidend zu sein, ob der Nutzer einen ausreichenden Beitrag zur Abfolge der Prompts und ihrer Anordnung geleistet hat, um als „Urheber“ angesehen werden zu können.

Auch wenn dieses Kriterium sich durchzusetzen scheint, muss man zugeben, dass seine Auslegung von Staat zu Staat sehr unterschiedlich ist:

Wenn 80 Stunden Arbeit und Tausende von Prompts nicht ausreichten, um das USCO davon zu überzeugen, dass Jason Michael Allens Beitrag ausreichend war, um als Autor des Weltraum-Opern-Theaters zu gelten, dann ist es fraglich, welches Niveau das USCO erwartet.

Umgekehrt scheint China großzügig zu sein, indem es das Bild einer jungen Frau als urheberrechtlich geschützt zugelassen hat, bei dem es fraglich ist, ob es wirklich eine ausreichende „Originalität“ im Sinne der grundsätzlichen Forderung des Urheberrechts aufweist.

Es kommt also darauf an, auf welcher Ebene man den Cursor setzen will, um eine ausreichende Kausalität zwischen dem Nutzer und dem erzeugten Ergebnis zu erkennen, um im ersten den Urheber des zweiten zu sehen.

Die grundlegende Frage, ob solche Ergebnisse angesichts des Zwecks des Urheberrechts, nämlich zur Schöpfung anzuregen, schützenswert sind, sollte ebenfalls gestellt werden. Sollte mir ein solches Recht auf ein „künstlerisches“ Ergebnis zuerkannt werden, obwohl ich in Wirklichkeit keine Fähigkeiten dazu habe und meine einzigen Qualitäten in der Fähigkeit liegen, effizientes Prompting zu betreiben?

Könnte das Prompting als Äquivalent zum Pinsel betrachtet werden, wie Jason Michael Allen argumentierte, ein Argument, das der USCO nicht gelten lassen wollte. Würde dies jedoch nicht das Risiko eingehen, das Niveau des Urheberrechts nach unten zu nivellieren, indem man einer sehr großen Mehrheit von Nutzern solche Rechte einräumt? Mehr noch, würde dies nicht bedeuten, das geforderte Niveau der Kreativität zu nivellieren, indem man letztendlich Urheberrechte für Millionen von Werken einräumt, die jeden Tag generiert werden? Wie hoch sollte die Messlatte gelegt werden? All dies sind Fragen, die es wert sind, gestellt zu werden, und die bislang noch nicht endgültig beantwortet wurden (für einen Austausch über diese Fragen siehe den interessanten Beitrag von Damian Flisak).

Haben Sie Fragen zu den in diesem Artikel behandelten Themen?

Unsere Anwälte lieben und verstehen das Wirtschaftsrecht, sowohl in der Schweiz als auch international. Sie sind sehr ansprechbar und tragen die Angelegenheiten ihrer Mandanten, um die beste rechtliche und praktische Lösung zu finden. Sie verfügen über langjährige internationale Erfahrung im Wirtschaftsrecht. Sie sprechen mehrere Fremdsprachen fließend und haben Korrespondenten in der ganzen Welt.

Avenue de Rumine 13

Postfach

CH – 1001 Lausanne

+41 21 711 71 00

info@wg-avocats.ch

©2024 Wilhelm Rechtsanwälte AG – Datenschutzerklärung – Realisierung Mediago